Come ben sanno gli addetti ai lavori, il Social media marketing (SMM per gli amici) è una branca del marketing digitale che utilizza le piattaforme Social per promuovere marchi, prodotti o servizi: strumenti e strategie per connettersi con il pubblico di riferimento, costruire relazioni, aumentare la visibilità del brand, e, in ultima analisi, raggiungere – o quantomeno, come vedremo, tentare di raggiungere – i propri obiettivi di business.

Secondo i giovani creativi delle agenzie, l’eldorado; secondo i vecchi relatori pubblici, un parco giochi per nerd, e per giunta di dubbia efficacia.

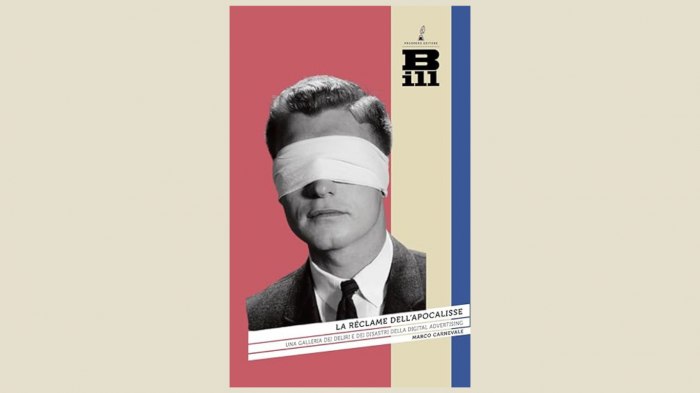

In medio stat virtus, dicevano in latino, ma per farsi un’idea ben ancorata a numeri e statistiche, e non solo a sensazioni, suggerisco la lettura del bel volume di Marco Carnevale La reclame dell’apocalisse (collana Bill di Prospero Editore): sarcastico, a volte velenoso, ma assai godibile, e in grado di stimolare più di un’interessante riflessione, sia per chi non va oltre l’orizzonte della propria tastiera, sia per chi vede il SMM come un “di cui” di una più ampia strategia di costruzione della reputazione.

Manipolare le evidenze di efficacia

Critico, Carnevale, sull’efficacia delle strategie di SMM: secondo lui “l’interattività non gode di buona salute”, e – a riprova – cita il fatto che Google già 9 anni fa smise di aggiornare (e poi addirittura rimosse in toto da Doubleclick, la funzione dedicata appunto alla web-ADV) il Display Benchmarking Tool, lo strumento – inizialmente utilissimo per gli investitori pubblicitari – che permetteva di monitorare l’efficacia delle campagne ADV. Carnevale, perfido, sostiene che il motivo sia stato il crollo verticale delle performance e dei ritorni degli investimenti, reso evidente in modo (troppo) trasparente proprio da quel cruscotto. In effetti le statistiche confermano che proprio il 2017 è stato – sarà un caso? – il periodo d’inizio del progressivo (poi inarrestabile) abbassamento del CTR (Click Through Rate, il numerino che misurava la quantità di interazioni online degli utenti con la pubblicità). Soluzione, quindi? Levare il misuratore di metriche, invece che interrogarsi sul perché i conti non tornavano più.

Nel settembre ’19, fece eco a Google la ricerca USA della società Small Insight, che confermò che il tasso medio di engagement pubblicitario online era sceso da 0,1% (dato 2016) a… 0.05% (dato 2018). “Ci sono cimiteri nei quali i processi di decomposizione delle salme fanno registrare indici di vitalità superiori – ironizza caustico Carnevale – ma questo evidentemente non è un problema per la nostra industria, che continua ad affollare plaudente decine di convegni nei quali si trastulla con i tecnicismi più astrusi sulla gestione dell’interattività, purché idonei a offuscare il dato della sua obiettiva inconsistenza, come fosse normale concentrarsi sulla perfetta ergonomia dell’impugnatura di un revolver che però fa fuoco solo 5 volte ogni 10.000 che si preme il grilletto”.

Aiuto, mi hanno profilato! O forse no

E che dire dei meccanismi di profilazione? Sarà capitato a tutti di visitare qualche pagina – o anche solo di parlare di un certo argomento ad alta voce con il cellulare accanto – e di venire dopo pochi minuti vedere i propri wall inondati di ADV e pop-up su quello specifico argomento, finalizzati a vendere prodotti o servizi che l’algoritmo ritiene per noi fondamentali. Come l’acquisto di biglietti aerei, ingressi a monumenti o prenotazioni di cene stellate in località dalle quali però – strano che l’algoritmo questo non lo sappia! – siamo già tornati, essendoci stati il mese scorso. Circostanze confermate da innumerevoli ricerche – tra tutte, quelle di Nico Neumann, professore della Melbourne Business School – che hanno dimostrato che i meccanismi di profilazione dei target da parte di big tech sono “nel migliore dei casi inaccurati, e nel peggiore del tutto inaffidabili”, che le metriche di misurazione dei risultati sono “spazzatura” e che il ritorno degli investimenti in pubblicità digitale gestiti in automatico dagli algoritmi di intelligenza (si fa per dire) artificiale tendono “ad essere addirittura inferiori a quelli che si registrerebbero in loro assenza”.

Altro dato interessante: nel 2014, tre anni dopo la scoperta che le piattaforme addebitavano agli inserzionisti anche gli annunci che non comparivano affatto sugli schermi dei device (!), la Media Rating Council USA formulò delle nuove linee guida, validate poi dall’autority internazionale in materia (IAB, International Advertising Bureau), ancora oggi in uso ovunque nel mondo, stabilendo che il costo dell’annuncio poteva essere addebitato se almeno il 50% dei pixel della ADV fosse comparsa per almeno 1 secondo (!) sullo schermo del telefonino dell’utente. Al giorno d‘oggi, META pare essere arrivata alla frutta, con l’abituale autenticità (sic!) che da sempre contraddistingue le politiche e le strategie di Zuckerberg: dal momento che gli annunci scorrevano per lo più ignorati, ora su Instagram vengono “bloccati” (interrompendo forzatamente lo scroll) per 3 secondi, obbligando l’utente a sorbirseli, distratto, per poi poter continuare ad usare il telefonino, e permettere così ai venditori di tappeti di Menlo Park di addebitare dollari agli ignari (o imbecilli?) investitori pubblicitari, spacciando per ore ed ore di visualizzazione ciò che a ben vedere è il nulla cosmico, esattamente come spacciano per “click” gli accessi al risultato di ricerca in cima alla prima pagina di Google, che tutti noi clicchiamo istintivamente solo per praticità, ma che Google rivende alle aziende inserzioniste come “obiettivo raggiunto”, dal momento che incidentalmente era un ADV (e noi spesso neppure lo sapevamo, dal momento che è esattamente identica per grafica ai risultati seguenti).

Bisogna davvero essere americani per riuscire a illudersi o arrivare a presupporre che il temporaneo blocco forzato di un annuncio digitale sullo schermo – prassi in grado di generare solo irritazione nell’utente, sia verso META, che spesso verso lo stesso brand pubblicizzato – sia una strategia utile per costruire buona reputazione e orientare conseguentemente i comportamenti di acquisto. CI sarà una ragione se il 95% dei proprietari di telefoni mobili al mondo, iPhone ma non solo, ha optato per il blocco dei cookies di terze parti (il “tesoro” di Meta e Google, indispensabili per tracciare le preferenze dell’utente) e laddove possibile anche degli annunci pubblicitari.

Inglesismi a gogò: ma il ROI?

Saltellando tra SEO copywriting, SEM, Direct Response Marketing, Referral e altre amenità simili, la domanda resta una: quanto rende realmente, e che ritorni è in grado concretamente di garantire, l’investimento sull’online?

Impossibile saperlo realmente, sia a causa della fitta cortina fumogena stesa da chi quegli spazi virtuali li vende, per mascherare la verità di score insignificanti e del tutto inattendibili, sia per colpa di chi dovrebbe vigilare, ovvero il mondo del giornalismo, che invece non fa che ripetere a pappagallo – e senza effettuare alcuna verifica – le veline e i comunicati stampa passati dai giganti Big Tech. Ed anche – non ultimo – a causa del fatto che, in base alle più recenti ricerche, il 65% del traffico online è generato da BOT, bias questo che sballa ulteriormente i conti, un po’ come se – ironizza Carnevale – “due terzi dell’audience delle TV fosse costituito da manichini”.

Per non parlare poi delle false impression, frodi online costruite sulla generazione di funnel in grado di far cliccare l’utente su ADV fraudolente, che hanno finito per pesare il 40% dei click nei soli Stati Uniti. Click che da un lato contribuiscono a gonfiare il traffico online, permettendo alle big tech di continuare nel proprio lavoro di illusionisti nei confronti degli inserzionisti, e – dall’altro lato – fanno perdere miliardi a investitori pubblicitari in buona fede, i quali affidano alle società di consulenza ADV ingenti capitali per banner pubblicitari che finiscono per apparire su siti farlocchi, per decisione insindacabile di algoritmi automatici le cui logiche sfuggono ai più, e che quindi non verranno visti praticamente da nessuno, ma “faranno comunque numero”.

E a big tech i numeri piacciono eccome, anche quelli falsi, tanto che nel 2019, anno nel quale Facebook su pressioni delle istituzioni pubbliche americane iniziò a fare pulizia di false account, ne eliminò solo nei primi 9 mesi ben 5,4 miliardi (si, miliardi, non è un errore di battitura…).

Non con gioia, però: proprio l’altra settimana ho personalmente segnalato per 3 volte a Instagram un profilo falso recante logo e nome (storpiato) di una Banca piemontese, la mia regione, profilo che ha evidentemente intenti fraudolenti, per vedermi chiudere la task con un messaggio dell’assistenza (sicuramente non “umana”) che ha affermato che “il team addetto al controllo ha rilevato che l’account segnalato non viola gli standard della community”; i quali, evidentemente, includono la possibilità di creare un profilo falso di una banca vera per promuovere chissà quale attività illegale; e a META sta benissimo così.

Big tech versus pubblicità, quella vera

In tutto ciò, TV e giornali come sono messi? Secondo i profeti delle ADV online “è roba da boomer”: peccato che gli stessi colossi che drenano sempre più miliardi alle aziende loro inserzioniste per l’acquisto di promozione sui canali digitali abbiano negli ultimi anni aumentato vertiginosamente i propri investimenti sui canali cosiddetti “tradizionali”, fino a diventare big spender mondiali appunto su televisione e carta stampata, canali che – lo confermano numerosissimi studi – continuano a garantire una brand awareness di tutto rispetto, e soprattutto misurabile.

Anche sorvolando sugli scandali nei quali i colossi USA dell’online sono stati periodicamente coinvolti, sulle innumerevoli violazioni della privacy (una tra tutte, le App di big tech possono tracciare i nostri movimenti e raccogliere informazioni su di noi attraverso parti terze anche se noi quella data App non l’abbiamo mai scaricata), sulla bassissima (a volte assente) imposizione fiscale garantita de governi compiacenti retti da politici solo formalmente attenti alla difesa degli interessi dei loro Paesi, sul ridicolo numero di dipendenti assunti (wordlwide 75.000 per Google e 17.000 per Facebook, per fare due esempi), sulle previsioni di sviluppo non confortanti, e sulla totale assenza di trasparenza circa gli algoritmi che condizionano il modo in cui percepiamo il mondo, già solo per questa questione della pubblicità digitale in parte poco utile e della manipolazione dei ritorni sull’investimento, la tentazione di gettare il bambino annegato nella sua acqua sporca è davvero fortissima. Possibilmente da un piano alto, così da assicurarci muoia veramente.

Nell’attesa di repliche dagli uffici stampa di big tech, che non arriveranno mai, ci piace ricordare che il reputation management è un costrutto complesso, multistakeholder, time-based e in continua e mutevole evoluzione, che la web-reputation (intesa come mera manipolazione degli algoritmi per far sparire articoli negativi) è una pratica ridicola e aberrante, e che se è vero che nel digitale ci siamo immersi molte ore ogni giorno, bastasse solo un ADV in mezzo a uno scroll per orientare un comportamento di acquisto le aziende che hanno speso miliardi di dollari in investimenti pubblicitari sui canali digitali avrebbero decuplicato il loro fatturato; e così non è stato.

Quella dei “califfi del click” – sostiene Carnevale – non è certamente “pubblicità”, la pubblicità quella vera è un’altra cosa, ben più seria e centrata su creatività in grado di generare emozione. È invece un enorme sistema parassitario basato sulla manipolazione di gonzi e sprovveduti investitori.

Severo ma giusto; e i numeri – purtroppo – paiono dargli ragione.