Superare il concetto di “digitalizzazione”

Una delle grandi sfide del XXI secolo sarà far convivere le complesse, stratificate, millenarie radici che abbiamo ereditato con le nuove ali in grado di far volare la matassa culturale ed artistica.

Superata, non senza qualche fatica, la dialettica tra fisico vs digitale, il dialogo si è focalizzato sul ruolo del digitale nella nostra quotidianità. L’approccio che ha prevalso è quello sintetizzabile come digitalizzazione. Termine diventato d’uso comune che nasconde una visione pienamente novecentesca nell’accettazione ed integrazione di nuovi linguaggi ed una propensione puramente tecnologica a scapito della matrice artistica e creativa.

Come suggerisce lo stesso vocabolo, digitalizzazione significa partire da un patrimonio fisico pre-esistente per convertirlo in un nuovo contenitore digitale. In questo è già ravvisabile l’idea del digitale come estensione del fisico e non come spazio di produzione indipendente, ma ci torneremo.

Archivi, quadri, statue, opere teatrali, edifici, spazi urbani, concerti vengono travasati nei “nuovi” mondi e diventano virtual tour, passeggiate dei direttori via Youtube, streaming di performance, archivi digitali. Questa ossessione per la de-materializzazione acquisisce valenza strategica se intesa come punto di partenza per future rielaborazioni altrimenti rischia di configurare un depauperamento dell’originale.

In fondo è impossibile chiedere molto ad un atto meramente tecnologico in cui non interviene alcuna nuova forma, o rielaborazione, creativa ed artistica.

Se si escludono le ragioni di ricerca e accessibilità, chi visiterà i numerosi database di beni culturali digitalizzati su cui sono già stati investiti centinaia di milioni di euro? Chi visiterà mai una città in modalità virtual tour quando può recarvisi fisicamente? Chi preferirà assistere in streaming alla Cavalleria Rusticana quando vi è la possibilità di esserne parte in un teatro?

Porto un esempio a esemplificazione di questa visione.

Dopo un iniziale successo commerciale accompagnato da numerosi articoli che lasciavano presagire la morte del libro cartaceo, il Kindle ha progressivamente visto calare i propri dati di vendita. A distanza di vent’anni dalla digitalizzazione avviata da Amazon ed altri player tecnologici, non solo il libro cartaceo non è morto ma sembra essere più vivo che mai. Se sono innegabili alcuni benefici legati al trasferimento tecnologico come la possibilità di ingrandire il carattere di lettura, immagazzinare grandi quantità di libri in soli cento grammi di scatola tecnologica o impostare ricerche velocemente tra migliaia di libri, questa esperienza di digitalizzazione non ha minimamente alterato i tre grandi pilastri di ogni esperienza culturale:

- PRODUZIONE: la modalità con la quale si concepiscono e scrivono i libri non è cambiata nel passaggio dal libro fisico al lettore digitale.

- CIRCUITAZIONE: Il modello economico e distributivo non è sostanzialmente cambiato. Il libro si acquista e la filiera distributiva è rimasta pressoché identica con Amazon che si sostituisce alle librerie.

- FRUIZIONE: Il modo in cui si legge un libro digitale è identico ad uno cartaceo, da pagina 1 a pagina 100 e da sinistra e destra (almeno in Occidente).

Digitale Nativo: verso nuovi contenuti

La digitalizzazione non solo non innova il modello pre-esistente ma spesso perde alcune delle caratteristiche intrinseche. Nel caso del libro perde l’odore delle pagine, la tattilità dello sfogliare il materiale cartaceo ed anche i processi di sottolineatura e prendere appunti rendono meno coinvolgente la nuova esperienza.

La risposta alla digitalizzazione è quella che amo chiamare Digitale Nativo. Un nuovo contenuto è pensato appositamente per un nuovo contenitore. Un’operazione in cui la componente tecnologica è sempre sussidiaria a quella creativa e culturale (al contrario di quanto accade nella digitalizzazione). Il contenuto può essere di totale nuova immaginazione o attingere a dei linguaggi e contenuti precedenti per ri-mediarli nella nuova esperienza.

Rimanendo nell’esempio connesso al libro, potrebbe essere l’evoluzione portata avanti da piattaforme come WATTPAD in cui si prova a disarticolare completamente il modello tradizionale. La comunità di centinaia di milioni di lettori e scrittori, largamente under 20, presenta una inedita modalità di scrittura. L’autore, che in un’epoca di digitale nativo ha più senso definirlo attivatore, scrive su una piattaforma che consente al lettore di leggere in tempo reale man mano che le righe, le pagine ed i capitoli prendono forma. La comunità può inserire suggerimenti, indirizzare la storia così come i personaggi ed i dialoghi. Nascono addirittura amicizie e dialoghi tra i follower di quell’opera work in progress, una vera e propria comunità di pratica che si coalizza intorno ad un contenuto non ancora cristalizzatosi.

I metaluoghi saranno processo ancora prima che prodotto. Paradossalmente saremo davanti a quello che definisco “opere nell’era della irriproducibilità tecnica” con le tecnologie native digitali in grado di invertire l’assunto del 1936 elaborato da Walter Benjamin. Se le tecnologie, e nel nostro bipolarismo la digitalizzazione, hanno favorito la riproducibilità tecnica potenzialmente infinita di un’opera d’arte, oggi i processi generativi la rendono mai finita e quindi irriproducibile (se non in un caleidoscopio di varianti). È quello che accade nelle installazioni di collettivi composti da centinaia di artisti come il giapponese Teamlab, è ciò che accade nei dialoghi con le intelligenze artificiali o ancora in quei videogiochi che offrono possibilità generatrici ai giocatori come Minecraft o Roblox.

Da attrattore ad attivatore

Un luogo culturale che porta avanti pratiche di digitalizzazione continua in una visione da Attrattore Culturale. Il luogo ambisce ad attrarre, fisicamente fino a pochi anni fa e digitalmente più recentemente, visitatori nei propri spazi, tempi e modalità. In sintesi sono le persone a dover fare uno sforzo di avvicinamento verso quel contenuto culturale. È questa la strada per essere rilevanti, memorabili e coinvolgenti nella vita di 8 miliardi di persone?

Lavorare sul digitale nativo per traslazione significa, invece, sperimentare approcci da Attivatore Culturale.

È un superamento dell’idea di attrattore da intendersi come un bene, materiale o immateriale, che avoca una centralità verso cui i pubblici dovranno convergere nei tempi e negli spazi indicati. È così per un museo, che tende a voler diventare un attrattore generando processi di gentrificazione culturale. L’attivatore invece trasporta il proprio contenuto nei tempi e nei luoghi dei pubblici e si avvale, necessariamente, di differenti linguaggi e della creazione e co-creazione dei pubblici che diventano soggetti attivi della circuitazione.

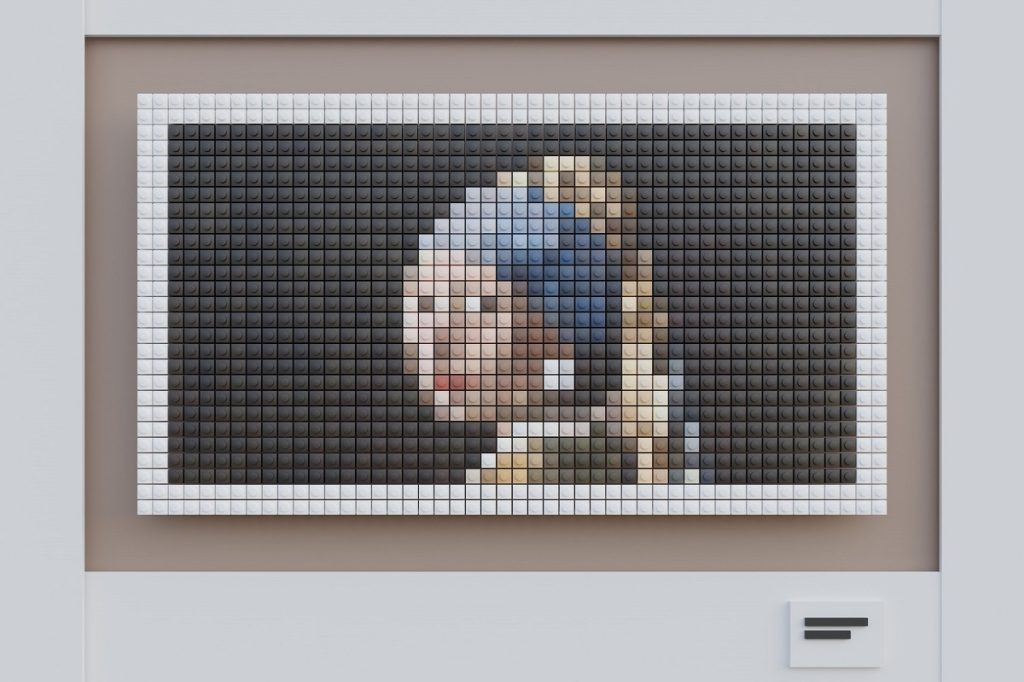

Le politiche tradizionali di tutela dell’immagine rientrano nella sfera dell’attrattore quasi in antitesi con istanze di accesso, rimodulazione e libero riutilizzo, anche commerciale, portate avanti spontaneamente nella rete o da istituzioni come Rjijksmuseum di Amsterdam che sono incasellabili nell’attivazione culturale. È un cambio epocale: da secoli siamo abituati ad un modello economico fortemente connesso alla proprietà intellettuale e diritto d’autore, al pagare per accedere a quell’atto creativo molto autoriale. Per quasi tutta la storia dell’uomo parole come diritto d’autore, proprietà intellettuale, copyright non sono esistite: questo sistema di tutela inizia a nascere a seguito della rivoluzione tecnologica della stampa a caratteri mobili e bisognerà attendere il 1700 per vedere emanati i primi corpus legislativi sulla tutela. Nelle società pre-alfabetiche così come nell’Antica Grecia o ancora nel Medioevo rielaborare creazioni altrui non solo era la norma ma anche parte integrante dei processi artistici e di diffusione e valorizzazione di quel contenuto. Ciò che è accaduto esclusivamente negli ultimi 500 anni entrerà a breve in una profonda crisi, perché ogni grande cambiamento tecnologico porta ad una distruzione e ricostruzione dei rapporti sociali, identitari ma anche economici.

Un nuovo modello di creazione del valore

L’ancoraggio a vecchi paradigmi, si pensi alle recenti sentenze sull’utilizzo dell’Uomo Vitruviano o al mercato degli NFT che provano ad attribuire chiuse proprietà in un’epoca di mura aperte, certifica la crasi in atto tra i vecchi sistemi novecenteschi o di digitalizzazione, ed i nuovi modelli di creazione collettiva e connettiva della pratica artistica.

Oggi il vero valore dei beni materiali ed immateriali è generato dalla ripetizione dell’esposizione a quel contenuto e la facilità con la quale, tecnicamente e legislativamente, potrà essere ripreso, rielaborato e re-immesso nella rete. È ciò che ha dimostrato pioneristicamente il Rjiksmuseum che, oltre una dozzina di anni fa, ha non solo digitalizzato e reso accessibili le proprie collezioni ma ha anche attribuito loro il libero utilizzo anche commerciale. A fronte di una immediata perdita di revenue generate dalla cessione dei diritti, si è assicurata nel medio-lungo periodo un aumento dei visitatori paganti, nuovi e diversificati incassi da bookshop, un aumento del valore delle proprie collezioni, un più ampio pubblico internazionale esposto ai contenuti e messaggi dell’istituzione etc etc. La continua circuitazione delle opere, la rielaborazione creativa da parte di creativi digitali e di aziende tradizionali (opere sui packaging del latte, texture a tema Van Gogh etc etc) ha aumentato il valore dell’originale ed aperto la strada a nuovi ed inediti modelli economici.

Il superamento dell’attuale diritto d’autore è un fattore fondante per il passaggio dalla digitalizzazione al digitale nativo. Per tutelare una percentuale infinitesimale di contenuti blockbuster (si pensi alle estensioni ad personam di cui gode la Disney), si condanna alla irrilevanza il 99% del patrimonio creativo mondiale. Come potrebbero diventare centrali archivi come le Teche Rai o Alinari se provassero a cambiare il proprio approccio verso ciò che conservano. Un immenso serbatoio creativo sostanzialmente inaccessibile per via delle restrizioni economiche e procedurali, che invece potrebbe generare nuove economie laddove libero di sprigionare le proprie ali grazie alle riprese di makers analogici e digitali.

Il modello economico potrebbe essere non più legato alla contrattazione individuale per accedere a quel contenuto ma, ad esempio, ad una percentuale legata all’eventuale successo di quella rielaborazione. O ancora come accaduto in ambito musicale, la distruzione del modello tradizionale basato sulla vendita degli album è stato compensato da incassi aumentati legati al concerto (più circola quella canzone liberamente maggiore sarà l’esposizione dell’artista), al boom del merchandising ed a nuove forme di interazione economica diretta tra artista e fan.

Quello che a prima vista potrebbe apparire come un depauperamento dell’opera in realtà conferisce una maggiore aura ed eternità. La riappropriazione creativa e popolare della matassa culturale di partenza ha consentito ai poemi omerici, alla Bibbia, alla Divina Commedia, alla fotografia Tank Man di Widener o ancora a Peter Pan di sopravvivere nei millenni o secoli. Cosa sarebbe accaduto se la Divina Commedia fosse stata congelata dal diritto d’autore? Avremmo perso la recitazione intorno al focolare dei contadini toscani, non sarebbero nate opere d’arte figurative come la Porta dell’Inferno di Rodin, Dorè non avrebbe potuto creare le iconiche incisioni e non sarebbero nati videogiochi come Dante’s Inferno. Questa continua ripresa ha contribuito a rendere ancora più classica l’opera e progressivamente attualizzarla in contesti cronologici successivi. Oggi la ripetizione dell’esposizione, la velocità con la quale circola e la facilità con la quale può essere rielaborata, forma il perimetro di una immagine. Tanto più è libera di viaggiare, anche a costo di essere interpretata in modo diametralmente opposto rispetto al pensiero dell’attivatore (Peter Pan che diventa addirittura una sindrome trattata in psicologia) maggiore sarà l’insorgenza di processi di spettattorialità.

Spettatore – spettATTORE – spettAUTORE

Una pre-condizione dei contenuti interattivi è la loro ripresa, mix, alterazione, condivisione e riappropriazione. Lo spettatore diventa spettATTORE attraverso un protagonismo a diversi gradienti che, pur mantenendo spesso chiara la matrice originaria del contenuto, consente al suo interno forme di protagonismo e partecipazione.

Al ruolo dello spettATTORE, negli anni recenti, sta subentrando lo spettAUTORE. Da intendersi come coloro i quali non si limitano ad agire all’interno di una cornice di movimento più o meno rigida ma creano e co-creano nuovi contenuti. Talvolta generati ex novo, in altri casi partendo da un contenuto/linguaggio pre-esistente, questa nuova generazione di creatori rompe definitivamente gli schemi del passato contribuendo ad un radicale passaggio dal focus sul “prodotto” finale a quello sul “processo”. Sintetizzando e semplificando si potrebbe affermare che il processo ha una attivazione iniziale e mai una fine, l’opera è in costante divenire e chi la maneggerà come spettatore la vivrà sempre in uno stadio intermedio. L’immagine interattiva come segno espressivo della società del XXI secolo con tutte le sue contraddizioni dettate dall’istantaneità, velocità, precarietà, desiderio di protagonismo e partecipazione.

Il futuro è un rapporto osmotico tra le competenze

Ho volutamente evitato di soffermarmi sulle singole tecnologie oggi in voga: realtà virtuale, realtà mixata, realtà aumentata, intelligenza artificiale, blockchain, metaverso perché da sole non fanno altro che creare nuove verticalità e spostare i perimetri dallo spazio materiale al nuovo spazio immateriale. Il futuro è nelle mani di quelle istituzioni che sapranno coniugare al proprio interno competenze umanistiche e scientifiche, un rapporto osmotico necessario a guidare la complessità del XXI secolo. Da questo dialogo nasceranno le risposte sulle nuove concezioni di spazio e tempo, il ruolo dello spettatore, i nuovi modelli economici legati alla produzione e circuitazione dei contenuti.

Anche perché, può sembrare paradossale, più si andrà avanti più conoscenze che sembravano ormai desuete acquisiranno nuova centralità. Per far funzionare le intelligenze artificiali come MidJourney e ChatGPT ritorna centrale la conoscenza linguistica ed il bagaglio lessicale unito all’immaginazione. Come potremo generare contenuti di qualità se non saremo in grado di fornire comandi (prompt) estremamente immaginifici, creativi e variegati?

ABSTRACT

Every profound technological change is matched by an ‘initial phase of rejection, followed by a superficial co-optation in which innovation is ancillary to the pre-existing model, and then leading to a traumatic disarticulation of what was there before in favor of what will be there in the future. Ideally, closing the cycle is the moment of re-mediation, in which the past and the present are sublimated, giving rise to social transformation. How will change the ways in which content is produced, circulated, and enjoyed in an era of “native digital” outpacing the current “digitization” paradigm? What will the audience’s role be in a society where space and time cancel out? How will copyright be overcome in an age when many of the new productions are collective and connective and therefore no longer crystallizable?