Il monito di Yoshua Bengio, tra i padri dell’intelligenza artificiale: «Prendereste un aereo che ha il 10% di probabilità di cadere?»

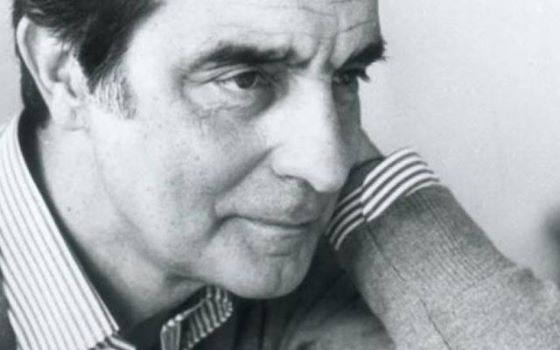

È lo scienziato con più citazioni scientifiche al mondo, tra i pionieri nelle tecnologie legate al deep learning e all’intelligenza artificiale. Ecco cosa ha detto a Roma in occasione del World Meeting on Human Fraternity invitato da Papa Leone XIV. Nelle sue parole l’allarme sui rischi dell’AI: «Stiamo costruendo macchine che possono superarci. Democrazie, pace e futuro a rischio perché vengono minate le fondamenta stesse della solidarietà umana»